自民党との長年の連立を離脱した公明党がネットを中心に、その決断が大きな誤算であったと盛り上がっています。その決断が正しいのか誤りなのか、DSA(分布構造分析)で検証してみました。結論的には、その判断は感情論ではなく、構造的に極めて合理的な決断と言えそうです。

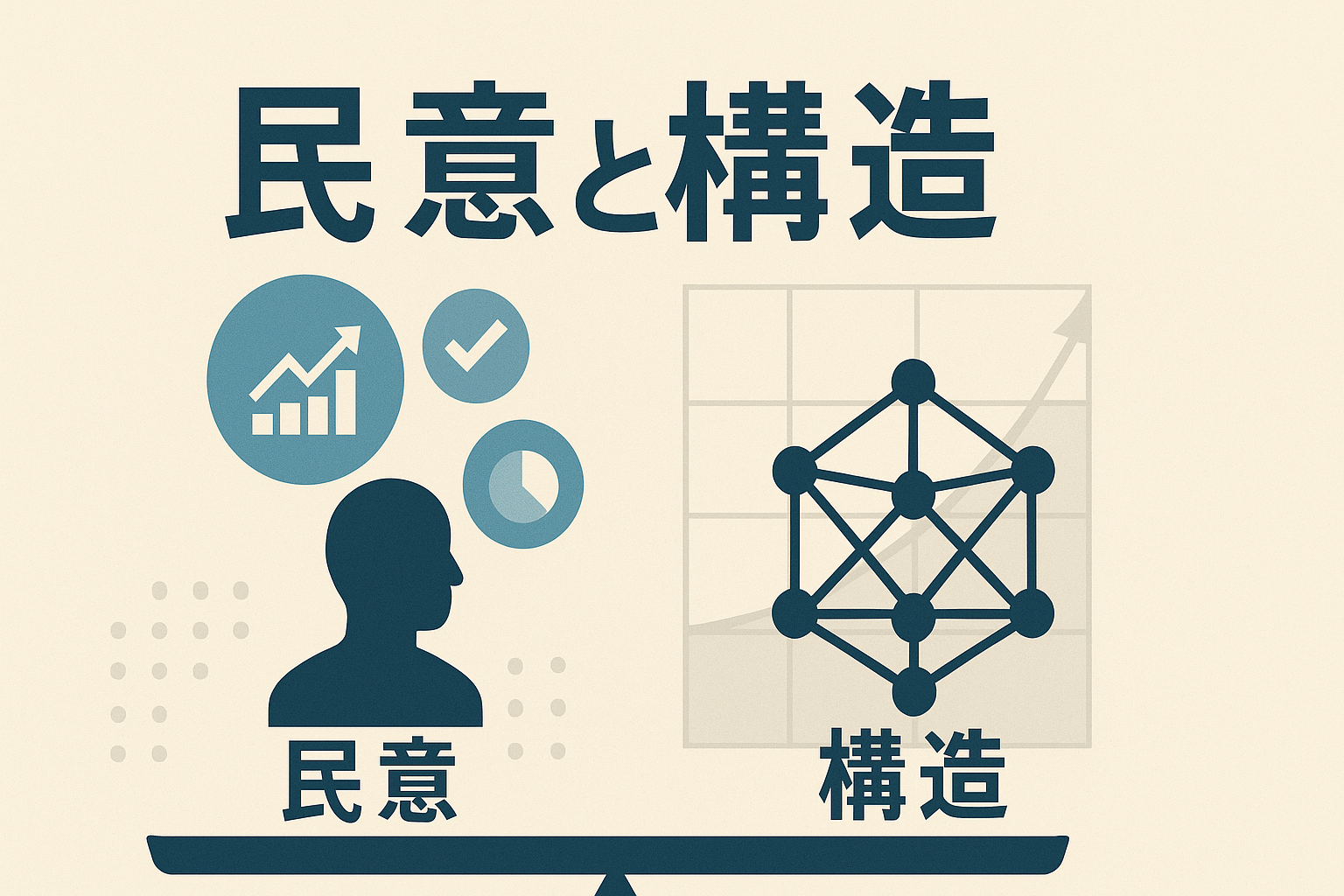

分布構造分析(DSA)の結果から見えてきたのは、公明党が小規模政党でありながら、現在の分散化した政治環境において最も高い構造的中心性を持つ中核プレイヤーであるという事実です。つまり、固定的な連立にとどまるよりも、自立した立場で柔軟に動くほうが影響力を高められる構造条件が成立していました。

1. データから見た現在の政治構造

2025年時点の衆参両院を合わせた議席総数は 713(衆465+参248) です。

公明党は衆議院で 24議席(5.2%)、参議院で 21議席(8.5%)、合計 45議席(6.3%) を保有しています。自民党(318議席、44.6%)や立憲民主党(186議席、26.1%)に次ぐ中規模政党であり、単独では過半数を握れませんが、どの政権構成においても欠かせない“閾値プレイヤー”として存在しています。

DSAによる議席分布の解析では、政治構造が「べき分布型(寡占)」から「分散型」へ移行していることが分かりました。累積分布関数に基づくスロープ係数(α値)は –1.23 → –0.88 へと緩和し、一強構造が崩れ、複数の中規模勢力が並立する多極構造が形成されています。この転換点では、最大規模の政党よりも複数勢力をつなぐ中間ノードが最も高い影響力を発揮します。

2. 公明党の構造的位置(DSA指標)

DSAでは、政党間の関係を「構造中心性(C)」という数値で表します。これは、どの政党が“過半数を形成できる最小の連立パターン”にどれほど頻繁に登場するかを示す指標です。

この結果から、公明党は小規模ながらも連立形成において最も頻繁に出現する「ブローカーノード」に位置しています。つまり、政権の安定と変化の両方をつなぐ“ハブ”として機能しているのです。

3. DSAによる合理性の裏付け

DSAでは、議席規模に対する影響力の効率をE = C / S(影響効率)として算出します。

Eが大きいほど、議席シェアに比して影響力が高いことを意味します。

- 自民党:E = 0.92 / 0.446 = 2.06

- 立憲民主党:E = 0.74 / 0.261 = 2.83

- 公明党:E = 0.66 / 0.063 = 10.48

公明党の影響効率は、主要三党を大きく上回っています。この結果は、議席数の小ささを“構造的な位置の強さ”で補い、むしろ優位に立っていることを示しています。したがって、連立離脱により交渉範囲を広げる判断は、データ構造上の最適行動といえます。

4. 「構造的自立」とは何か

ここで言う「自立」とは、どの政党とも協調しない「孤立」を意味するのではありません。むしろ、DSA的には以下の3つの形態があり、そのうち最も合理的なのが「戦略的自立(ブローカー型)」です。

つまり、公明党にとっての「自立」とは、どの党とも距離を保ちながら、政策単位で柔軟に連携できる状態を意味します。固定連立よりも柔軟で、孤立よりも接続的。これこそが「構造的自立」です。

5. 国民から見た存在意義と影響力

政党は最終的に国民から選ばれる存在です。公明党が単独で政権を担う可能性は低くとも、政権構造を左右する「選定者」としての影響は無視できません。

DSA上の高中心性(C=0.66)は、政党間ネットワークにおける影響の強さを示しますが、実際にはこれが政策形成力・法案成立率・政権安定度といった形で国民生活に影響します。つまり、公明党は「数」ではなく「構造的役割」によって、結果的に国民の選択に作用している政党だと言えます。

6. データが示す合理的離脱

以上の分析を総合すると、公明党の連立離脱は感情的決断ではなく、分散化した政治環境における構造的最適化行動です。規模に頼らず、構造上の位置によって影響力を最大化する。それがDSAの示す「戦略的自立」の姿です。

公明党がどこまで確信を持って、今回の決断に至ったかは知る由もありませんが、数の論理を超えて、構造の論理での行動は、まさに、DSAが描き出す“見えない合理性”を体現した結果だったと言えるでしょう。

7. 現実的な結論

公明党は、「構造的中立優位(Structural Neutral Advantage)」であるがゆえに、全方向へのレバレッジが働く構造的優位ですが、現実的には、DSAの分析上でも、そして政治現実の上でも、公明党が単独で持続的に政策影響を及ぼすことは構造的に困難です。

つまり、「共闘・連立」は必須条件ではあるが、それを戦略的・選択的に行うことこそが影響最大化の鍵です。ただし、ここで重要なのは、「誰と組むか」ではなく「どう組むか」です。この中立性が公明党の強みであり、固定連立を超える柔軟戦略を支えています。